Wer trägt die KI-Transformation?

Verantwortung, Arbeit und Gesellschaft im Zeitalter der Künstlichen Intelligenz

📋 Diskussionsentwurf v0.7.5Künstliche Intelligenz verändert Arbeit, Sozialstaat, Demokratie und unser Zusammenleben. Die entscheidende Frage lautet nicht nur, was technisch möglich ist — sondern wer Verantwortung dafür übernimmt, dass diese Transformation menschenwürdig bleibt.

Drei Erzählungen prägen die öffentliche Debatte: KI als Jobvernichter, KI als Lösung des Fachkräftemangels, demografische Alterung als Pensionskrise. Jede für sich ist zutreffend. Zusammengenommen ergeben sie keine konsistente Antwort — es sei denn, man bringt die Verteilungsfrage ins Zentrum. Wer Pensionsreform, KI-Regulierung und Sozialstaat getrennt diskutiert, übersieht, dass diese Stränge in der Wirklichkeit zusammenwirken.

Die Klimaforschung verfügt seit dreißig Jahren über integrierte Modelle, die Politik, Ökonomie und Naturwissenschaft zusammenbringen. Für die KI-Transformation existiert nichts Vergleichbares — obwohl ihre Verwerfungen mindestens gleich groß sein dürften.

Welche Kombination von Maßnahmen hält eine Gesellschaft unter KI-Druck menschlich, demokratisch und sozial tragfähig?

Dieses Diskussionspapier legt kein fertiges Modell vor, sondern stellt den Versuch dar, die Anforderungen zu formulieren, denen ein solches Modell genügen müsste, um legitimationsfähig zu sein. Es möchte als Diskussionsimpuls gesehen werden, um eine notwendige multi-disziplinäre Debatte zu eröffnen.

Methodischer Hinweis

Dieses Papier ist ein KI-gestützt erarbeiteter Diskussionsentwurf. Es versteht sich nicht als wissenschaftlicher Nachweis und nicht als fertiges Modell, sondern als Versuch, zentrale Fragen der KI-Transformation zusammenzuführen. Quellen, Zusammenhänge und Schlussfolgerungen sollten kritisch geprüft werden. Korrekturen und Einwände sind ausdrücklich willkommen.

Vier Zugänge zum Thema

Die Geschichte

„Das Erbe der Maschinen“. Eine Geschichte über das Grundeinkommen, die Freiheit und die Frage, wie unsere Zukunft aussehen könnte.

↓ Download (PDF)Die Kurzfassung

Etwa fünfzehn Seiten. Acht Pfade, sechs Kipppunkte, sechs Synthese-Komponenten, fünfzehn Kernvariablen. Geeignet zur schnellen Orientierung.

↓ Download (PDF)Die Vollversion

Etwa sechzig Seiten. Vollständige Argumentation in 21 Abschnitten mit Quellenanhang, methodischen Vorbehalten, Eschbach-Sonde und detaillierter Modul-Architektur.

↓ Download (PDF)Die Szenarien-Durchspielung

Etwa fünfzehn Seiten. Der Versuch die Frage: „Welche Kombination von Maßnahmen hält eine Gesellschaft unter KI-Druck menschlich, demokratisch und sozial tragfähig?“ in acht Pfaden über drei Phasen bis 2046 durchzuspielen — mit einer Trade-off-Tabelle in neun Dimensionen. Methodisch transparent über ihre Grenzen.

↓ Download (PDF)Die Leerstelle: vier Asymmetrien, die niemand zusammen denkt

Die KI-Transformation entfaltet sich asymmetrisch — und das macht sie für eindimensionale Politiken unzugänglich. Vier Asymmetrien sind besonders relevant:

1. Sektorale Asymmetrie

In Pflege, Bildung und Handwerk fehlen Arbeitskräfte. Gleichzeitig ist die KI-Substitution in Büroarbeit, Sachbearbeitung und einfacher Programmierung bereits messbar. Der Mangel bleibt, wo er ist; die Verdrängung passiert woanders. Eine Statistik mit Durchschnitten verschleiert beides.

2. Zeitliche Asymmetrie

Die KI-Substitution beschleunigt sich rekursiv. Die demografische Lücke entwickelt sich linear. Die Schere öffnet sich nicht langsamer, sondern schneller. Heutige Regierungspolitik geht implizit davon aus, dass der heutige Zustand der Normalzustand bleibt — eine Annahme, die wahrscheinlich falsch ist.

3. Qualifikationsasymmetrie

Die freiwerdenden Arbeitskräfte aus Bürotätigkeiten haben nicht die Qualifikationen für die Mangelsektoren in Pflege, Bildung und Handwerk. Umschulung dauert Jahre und gelingt nicht für alle. Die Vorstellung, freiwerdende Arbeitskräfte würden einfach „in die Engpasssektoren wechseln“, ignoriert diese Wirklichkeit.

4. Verteilungsasymmetrie

Produktivitätsgewinne aus KI fließen primär in Kapitalerträge, nicht in Löhne. Damit fällt die Finanzierungsbasis der sozialen Sicherung weg, obwohl die Wirtschaft als Ganzes produktiver wird. Das Pensionssystem kollabiert nicht in erster Linie wegen zu weniger Arbeiter:innen — es kollabiert, weil Produktivitätsgewinne nicht mehr bei den Löhnen ankommen.

Die quantitative Bandbreite seriöser Schätzungen: Die OECD (Employment Outlook 2023) schätzt, dass etwa 27 Prozent der Beschäftigten in OECD-Ländern in Berufen mit hohem Automatisierungsrisiko stehen. Die ILO (Working Paper 140/2025) findet weltweit eine Vierteler GenAI-Exposition, in Hochlohnländern 34 Prozent. Das WEF (Future of Jobs Report 2025) projiziert bis 2030 eine strukturelle Arbeitsmarkt-Verschiebung von 22 Prozent — 170 Millionen neue Stellen, 92 Millionen verdrängte. McKinsey (2023/2024) schätzt etwa 30 Prozent automatisierbare Arbeitsstunden bis 2030.

Wichtig: Exposition ist nicht gleich Automatisierung. Verschiebung ist nicht gleich Massenarbeitslosigkeit. Aber die Größenordnung ist substantiell, und die Verteilung der Anpassungskosten ist die eigentliche politische Frage.

Die Modul-Architektur des Modells

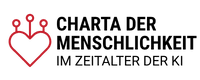

Ein integratives Simulationsmodell muss fünfzehn Module abdecken — nicht alle gleich gewichtig. Die Klassifikation in Kernmodule (kausal treibend), Querschnittsmodule (durchdringend wirkend) und Begleitmodule (qualifizierend) macht sichtbar, wo politische Energie zuerst ansetzen muss.

Diagramm 1: Modul-Architektur mit Prioritäten. Kernmodule treiben, Querschnittsmodule durchdringen, Begleitmodule qualifizieren.

Die Hierarchisierung ist eine begründete Annahme, kein empirischer Befund. Sie folgt aus der Argumentation des Hauptpapiers und aus Plausibilitätsüberlegungen — eine andere Forscher:innengruppe könnte mit guten Gründen zu einer anderen Anordnung kommen. Die Dreiteilung dient hier nicht der Festlegung, sondern der Strukturierung der Diskussion.

Die Pfadlandschaft mit Kipppunkten

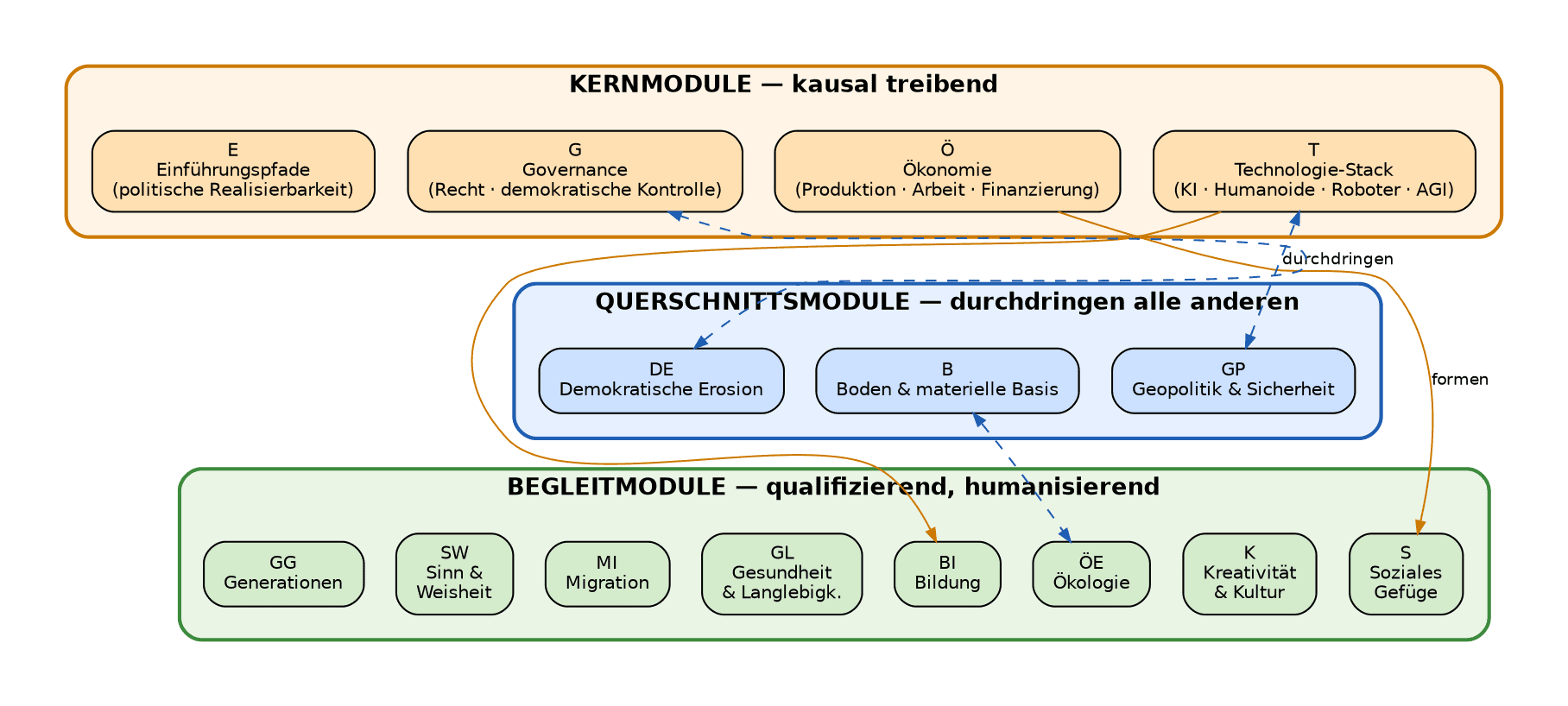

Acht mögliche Pfade — von Laissez-faire über Silicon-Valley-BGE und europäisch-sozialstaatliche Lösungen bis zu autoritär-technokratischer Stabilisierung. Pfeile zeigen wahrscheinliche Übergänge unter Kipppunkt-Druck.

Diagramm 2: Pfadlandschaft, Kipppunkte und mögliche Übergänge. Pfad D (Commons) ist nach der qualitativen Analyse der robusteste Pfad. Pfad F (AGI-Schwelle) wirkt als Regimeüberlagerung.

Die zentrale strategische Aussage: Pfad D (Commons) ist nach der qualitativen Analyse der robusteste Pfad gegen alle sechs Kipppunkte — und gleichzeitig politisch am schwersten durchsetzbar. Pfad C (europäisch-sozialstaatlich) ist die wahrscheinlichste tragfähige europäische Antwort. Die positive Entwicklungsrichtung verläuft von E über C nach D. Pfad F (AGI) ist kein eigener Pfad, sondern eine mögliche Überlagerung, die jeden Pfad transformieren würde, falls sie eintritt.

Sechs Kipppunkte — wann das System brechen könnte

Eine Vorbemerkung zur Sprache. Die folgenden sechs Kipppunkte sind als Möglichkeitsszenarien formuliert, nicht als Prognosen. Sie behaupten nicht, dass diese Brüche eintreten werden. Sie behaupten, dass ihre Möglichkeit ernst genug ist, um sie nicht auszublenden. In der Klimaforschung ist das ein etablierter Standard — Tipping-Point-Analysen werden dort geführt, ohne dass die Forschung den Eintritt prognostiziert. Dieselbe Logik wird hier angewandt.

1. Soziale Unruhen. Wenn die Diskrepanz zwischen Wahrnehmung der KI-Bedrohung und politischer Antwort zu groß wird, kann sich Unmut in nicht-institutionellen Mobilisierungsformen entladen. Reversibel, aber institutionelles Misstrauen kann bleiben.

2. Systemvertrauensverlust. Vertrauen in Institutionen wird in Jahrzehnten aufgebaut, kann aber in Monaten zerfallen — etwa wenn Pensionssystem oder Sozialleistungen wahrnehmbar versagen. Hysterese hoch.

3. Politische Radikalisierung. Wenn populistische Parteien Stimmenanteile von 25–35 Prozent überschreiten, normalisieren sich extreme Positionen. Auch nach Wahlniederlagen können diese Strukturen aktiv bleiben.

4. Ökonomische Kaskaden. Steigende Staatsverschuldung bei sinkendem Wachstum, Risikoprämien auf Staatsanleihen, Druck auf Pensionsfonds — die Wechselwirkungen können sich wechselseitig verschärfen.

5. Technologische Disruption (AGI-Schwelle). Sprünge in Benchmarks für allgemeine Intelligenz, autonome KI-Agenten in offenen Umgebungen. Eintrittswahrscheinlichkeit und Zeithorizont sind unter Forschenden kontrovers. Hysterese im Eintrittsfall: irreversibel.

6. Demokratischer Kollaps. Kumulation der anderen Kipppunkte, Angriffe auf Justiz und Medien, Normalisierung außerordentlicher Maßnahmen. Hysterese sehr hoch — meist nicht Anfang, sondern Endpunkt einer Kaskade.

⚠️ Die Logik der Kaskade: Die Kipppunkte stehen nicht isoliert. Soziale Unruhen erhöhen die Radikalisierungswahrscheinlichkeit; Radikalisierung erodiert Systemvertrauen; erodiertes Systemvertrauen begünstigt ökonomische Kaskaden; ökonomische Kaskaden verschärfen soziale Unruhen. Wer den demokratischen Kollaps verhindern will, sollte früh in der Kaskade ansetzen — reaktive Verteidigung der Demokratie zeigt in der historischen Bilanz oft eine schwache Erfolgsquote.

Zeithorizont: sieben bis zehn Jahre

Das Zeitfenster für die Ausarbeitung und politische Verankerung tragfähiger Strukturen lässt sich nicht punktgenau bestimmen, aber sinnvoll einkreisen: eine plausible Schätzung sind sieben bis zehn Jahre — also bis 2033 bis 2036.

Drei Anker dafür: Erstens, die KI-Verwerfung selbst — die McKinsey-Schätzung von 30 Prozent automatisierbarer Arbeitsstunden bis 2030 könnte zwischen 2028 und 2032 in deutlich mehr Sektoren spürbar werden. Zweitens, die Trägheit demokratischer Willensbildung — große Reformen brauchen fünf bis zehn Jahre vom Beginn der Debatte bis zur Gesetzgebung. Drittens, die Lehre aus Krisenreaktionen — in akuten Krisen werden Lösungen von jenen entworfen, die mit fertigen Vorschlägen am Tisch sitzen.

Die Uhr tickt nicht erst, wenn Massenarbeitslosigkeit eingetreten ist. Sie tickt jetzt — nicht für die Lösung selbst, sondern für die Voraussetzungen einer legitimationsfähigen Lösung.

Offene Fragen — Einladung zum Dialog

- Welche Module sind hier noch schärfer zu fassen — insbesondere ihre Wechselwirkungen?

- Welche Werturteile, die hier implizit getroffen wurden, sind angreifbar oder zu korrigieren?

- Welche historischen Analogien tragen tatsächlich, welche sind trügerisch?

- Welche konkreten Forschungseinrichtungen, Stiftungen oder zivilgesellschaftlichen Träger könnten eine Pilotumsetzung anstoßen?

- Welche Stimmen fehlen in dieser Debatte — und wie können sie eingebracht werden?

Pfad D — Die Bausteine existieren bereits

Pfad D im Diskussionspapier — das Commons-Modell der KI-Transformation — ist keine Utopie. Seine wesentlichen Bausteine existieren bereits: in Initiativen, Bewegungen und institutionellen Ansätzen, die bislang weitgehend getrennt voneinander arbeiten.

Was fehlt, ist nicht die Idee. Was fehlt, ist die Verbindung.

Eine stärkere Aufmerksamkeit und Durchsetzungskraft entstünde dort, wo diese Ansätze gemeinsam gedacht, koordiniert und als zusammengehörige Bewegung sichtbar werden. Die folgende Liste ist keine vollständige Aufzählung — sie ist eine Einladung zur Konvergenz.

Die Commons-Architektur der KI-Transformation braucht drei Dimensionen gleichzeitig: eine andere Eigentumslogik (wer besitzt KI-Infrastruktur?), eine andere demokratische Betriebsform (wer entscheidet darüber?), und eine andere Finanzierungsgrundlage (wer trägt die Transformation?). Und sie braucht eine Governance-Schwelle: demokratische Handlungsfähigkeit muss erhalten bleiben, bevor sie durch unkontrollierte Entwicklung überholt wird. Alle vier Dimensionen sind bereits in konkreten Initiativen angelegt.

Eigentumslogik und Wirtschaftsmodell

Gemeinwohl-Ökonomie

Die GWÖ überträgt die Grundfrage von Pfad D in ein wirtschaftstheoretisches System: Nicht Gewinnmaximierung, sondern Gemeinwohl ist das Ziel des Wirtschaftens. Die Gemeinwohl-Bilanz ist ein konkretes Steuerungsinstrument. GWÖ Österreich hat 2026 ein Policy Paper „KI im Dienst des Gemeinwohls“ veröffentlicht: gemeinwohlorientierte KI-Ökosysteme, auditierbare Open-Source-Modelle, partizipative digitale Gemeingüter.

econgood.org →GLS Bank

Deutschlands erste sozial-ökologische Genossenschaftsbank seit 1974 — jedes Mitglied hat eine Stimme, unabhängig von der Einlagenhöhe. 154.000 Mitglieder, 388.000 Kunden, 11,6 Milliarden Euro Bilanzsumme. Finanziert ausschließlich ökologische, soziale und kulturelle Projekte — kein Cent in Rüstung, Atomkraft oder Spekulation. Das ist die Finanzierungslogik, die Pfad D für KI-Infrastruktur braucht.

gls.de →Demokratische Betriebsform

Souveräne Demokratie

Christian Felbers Konzept erweitert demokratische Partizipation auf Konvente und direkte Volksentscheide auf allen politischen Ebenen. Es ist die institutionelle Betriebsform dessen, was Pfad D unter demokratischer Kontrolle von KI-Infrastruktur versteht: nicht nur Regulierung, sondern strukturelle Mitentscheidung der Bevölkerung.

mehr-demokratie.at →Democracy International

Internationale NGO für direkte Demokratie und Bürgerbeteiligung weltweit — Volksabstimmungen, Bürgerkonvente, Referenden. Verbindet zivilgesellschaftliche Bewegungen über Ländergrenzen hinweg. 2026 Global Forum on Modern Direct Democracy in Gaborone. Wo Felbers Souveräne Demokratie die Theorie liefert, liefert Democracy International die internationale Praxis und Vernetzung.

democracy-international.org →D64 — Demokratische KI

D64 — Zentrum für digitalen Fortschritt hat gemeinsam mit über 50 Organisationen einen Code of Conduct für Demokratische KI entwickelt: Transparenz, Teilhabe, ökologische Nachhaltigkeit als Grundprinzipien. D64 untersucht dezentrale Ansätze für eine demokratischere digitale Zukunft — von öffentlichen Verwaltungsinfrastrukturen bis zu Alternativen zu Plattform-Monopolen.

demokratische-ki.de →Wikimedia — Digital Public Goods

Wikimedia Deutschland setzt sich für öffentliche digitale Infrastrukturen als Gemeingüter ein. Wikidata wurde 2025 von der UN-unterstützten Digital Public Goods Alliance als digitales Gemeinwohl anerkannt. Deutschland, Frankreich, Niederlande und Italien haben das Digital Commons EDIC gegründet — öffentliche KI-Infrastruktur als europäisches Gemeingut.

wikimedia.de →Finanzierungsgrundlage

attac — Steuergerechtigkeit

attac Österreich hat konkrete Finanzierungsmodelle ausgearbeitet: Eine progressive Vermögensteuer könnte in Österreich bis zu 22 Milliarden Euro zusätzlich bringen. Die attac-Inhaltsgruppe Grundeinkommen versteht das BGE als Recht auf ein selbstbestimmtes Leben — zusätzlich zum Sozialstaat, nicht als Ersatz.

attac.at →ÖGB — Arbeitszeitverkürzung

Der ÖGB fordert Arbeitszeitverkürzung bei vollem Lohnausgleich. Das isländische Modell hat gezeigt: 86 Prozent der Erwerbsbevölkerung konnten effektive Arbeitszeitverkürzung erreichen. Das entspricht Synthese-Komponente 4 des Diskussionspapiers — einer der am weitesten fortgeschrittenen Teilkomponenten.

oegb.at →Governance-Schwelle — Vorbedingung

PauseAI und ControlAI kommen aus einem anderen Ausgangspunkt: Sie fragen nicht zuerst, wer die Infrastruktur besitzt, sondern ob die Entwicklung nicht bereits so weit gegangen ist, dass demokratische Kontrolle überholt wird. Das ist keine Konkurrenz zu Pfad D — es ist seine Vorbedingung. Commons-Strukturen für KI-Infrastruktur können nur aufgebaut werden, wenn demokratische Handlungsfähigkeit noch existiert.

PauseAI Deutschland

PauseAI Deutschland ist Teil einer internationalen Bewegung, die sich gegen die Entwicklung gefährlicher KI-Systeme einsetzt. PauseAI ist parteipolitisch unabhängig. Ihr Maßstab sind wissenschaftliche Erkenntnisse, demokratische Grundwerte und die Souveränität der Menschheit. PauseAI wollen nicht heutige KI abschaffen, sondern fordern ein globales Abkommen, das die Entwicklung unkontrollierbarer KI-Systeme verhindert.

pause-ai.de →ControlAI

ControlAI verfolgt eine institutionelle Strategie: parlamentarische Einflussnahme, Sensibilisierung von Abgeordneten für KI-Sicherheitsfragen, konkrete Policy-Empfehlungen. Wer Pfad D will, hat ein Interesse daran, dass die Governance-Schwelle nicht überschritten wird, bevor die demokratischen Strukturen für Commons-Eigentümerschaft stehen.

controlai.com →Eine Einladung zur Konvergenz. Diese Initiativen arbeiten an denselben Grundfragen — in verschiedenen Sprachen, auf verschiedenen Ebenen, mit verschiedenen Adressaten. Das Diskussionspapier versteht sich als Brückentext: Es benennt den gemeinsamen analytischen Rahmen, in dem diese Ansätze zusammengehören. Eine Koordination zwischen ihnen würde Aufmerksamkeit und Durchsetzungskraft erzeugen, die keine Initiative alleine hat.

Methodik und Transparenz

Ich habe nicht jede Quelle dieses Papiers selbst gelesen oder vollständig verifiziert. Ausgangspunkt waren meine Fragen, Zusammenhänge sichtbar zu machen, sowie Diskussionen mit KI-Systemen, deren Antworten ich auf Plausibilität geprüft habe. Trotzdem können KI-Systeme täuschen: Manche Zusammenhänge klingen überzeugend, halten einer direkten Quellenprüfung jedoch nicht immer stand. Das ändert jedoch nichts an der Ernsthaftigkeit meines Anliegens und der Relevanz der hier zusammengetragenen Fragen.

Dieses Papier versteht sich daher nicht als wissenschaftlicher Nachweis, sondern als mein Versuch, mithilfe von KI ein komplexes Problemfeld sichtbar zu machen und Fragen zusammenzudenken, die meines Erachtens gesellschaftlich zu wenig gemeinsam betrachtet werden.

Die normativen Entscheidungen — welche Fragen relevant sind, was schützenswert erscheint und welche Entwicklungen Anlass zur Sorge geben — liegen bei mir. Formulierungen, Strukturierungen und Teile der Recherche entstanden mit Unterstützung von KI-Werkzeugen.

Die Verantwortung für die Veröffentlichung übernehme ich — mit dem ausdrücklichen Vorbehalt, dass nicht alle Inhalte vollständig verifiziert werden konnten.

Offene Diskussion und kritische Prüfung sind ausdrücklich Teil dieses Prozesses. Ich lade dazu ein, sich mit dem Thema auseinanderzusetzen — auch im Bewusstsein, dass KI-gestützte Texte zunehmend Fragen nach Einordnung, Verlässlichkeit und tatsächlicher Expertise aufwerfen.